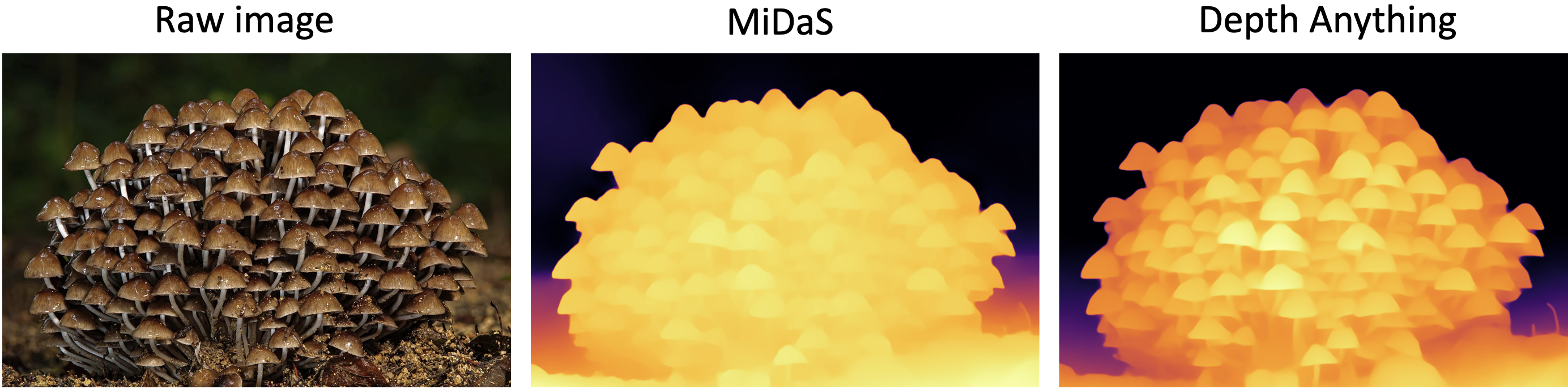

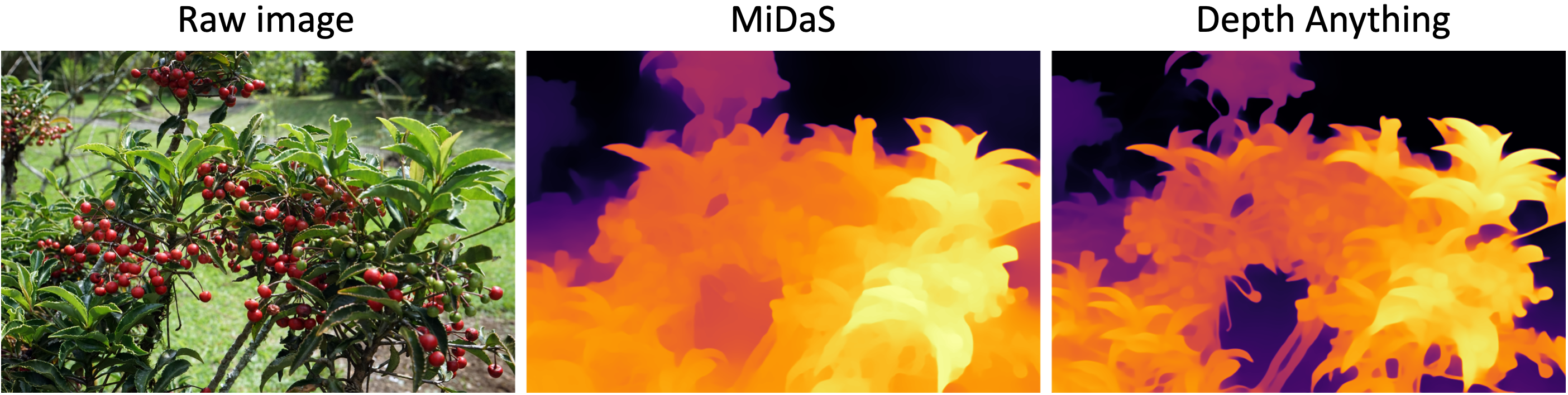

이 연구는 강력한 단안 깊이 추정을 위한 매우 실용적인 솔루션인 Depth Anything을 제시합니다. 새로운 기술 모듈을 추구하지 않고 어떠한 상황에서도 모든 이미지를 다루는 단순하면서도 강력한 기반 모델을 구축하는 것을 목표로 합니다. 이를 위해 레이블이 없는 대규모 데이터(~62M)를 수집하고 자동으로 주석을 달기 위한 데이터 엔진을 설계하여 데이터 세트를 확장합니다. 이는 데이터 범위를 크게 확대하여 일반화 오류를 줄일 수 있습니다. 우리는 데이터 확장을 유망하게 만드는 두 가지 간단하면서도 효과적인 전략을 조사합니다. 첫째, 데이터 증강 도구를 활용하여 더욱 까다로운 최적화 목표가 생성됩니다. 이는 모델이 추가 시각적 지식을 적극적으로 찾고 강력한 표현을 얻도록 강제합니다. 둘째, 사전 훈련된 인코더로부터 풍부한 의미론적 사전 정보를 상속하도록 모델을 강화하기 위해 보조 감독이 개발되었습니다. 우리는 6개의 공개 데이터세트와 무작위로 캡처한 사진을 포함하여 제로샷 기능을 광범위하게 평가합니다. 인상적인 일반화 능력을 보여줍니다. 또한 NYUv2 및 KITTI의 메트릭 깊이 정보로 미세 조정을 통해 새로운 SOTA가 설정됩니다. 우리의 더 나은 깊이 모델은 또한 훨씬 더 나은 깊이 조절 ControlNet을 생성합니다. 모든 모델이 출시되었습니다.

Depth Anything은 150만 개의 레이블이 지정된 이미지와 6200만 개 이상의 레이블이 지정되지 않은 이미지에 대해 공동으로 훈련되어 다음 기능을 갖춘 가장 유능한 MDE(단안 깊이 추정) 기반 모델을 제공합니다.

데이터들이 https://github.com/nerfies/nerfies.github.io 에서 가져와 사용했다.

https://github.com/LiheYoung/Depth-Anything

GitHub - LiheYoung/Depth-Anything: [CVPR 2024] Depth Anything: Unleashing the Power of Large-Scale Unlabeled Data. Foundation Mo

[CVPR 2024] Depth Anything: Unleashing the Power of Large-Scale Unlabeled Data. Foundation Model for Monocular Depth Estimation - LiheYoung/Depth-Anything

github.com

https://depth-anything.github.io/

Depth Anything

This work presents Depth Anything, a highly practical solution for robust monocular depth estimation. Without pursuing novel technical modules, we aim to build a simple yet powerful foundation model dealing with any images under any circumstances. To this

depth-anything.github.io

'AI > StableDiffusionWebUI' 카테고리의 다른 글

| 스테이블 디퓨전 무료 사용법 - AUTOMATIC1111 webui 설치 방법 (0) | 2024.05.15 |

|---|---|

| an adorable cartoon style cat (1) | 2024.04.02 |

| Marigold (0) | 2023.12.25 |

| ComfyUI Portrait Master 2.3 (0) | 2023.12.24 |

| StableDifusion xl movie (0) | 2023.12.24 |

댓글